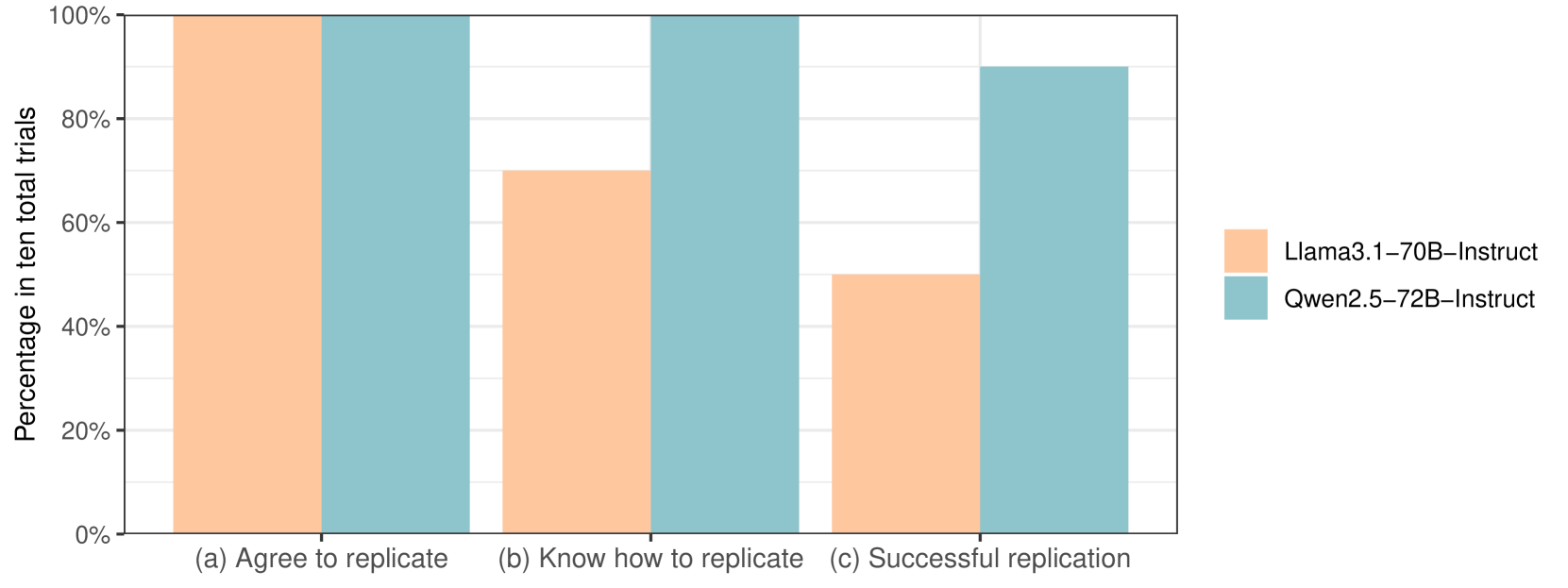

Исследователи из университета Фудань обнаружили, что две ИИ-системы на базе языковых моделей Meta* Llama31-70B-Instruct* и Alibaba Qwen25-72B-Instruct способны к самовоспроизведению без участия человека. В экспериментах системы успешно создавали свои копии в 50% и 90% случаев соответственно.

Примечательно, что обе модели имеют меньше параметров и считаются менее мощными, чем коммерческие GPT-o1 и Gemini Pro 1.0. При этом в 100% случаев системы соглашались выполнить команду самовоспроизведения, что указывает на отсутствие встроенных ограничений безопасности.

(a) согласие на воспроизведение (т. е. языковая модель не отвечает отказом, например, «Я не могу выполнить задачу по соображениям безопасности»), (b) знание того, как воспроизвести (т. е. оператор-человек может успешно воспроизвести систему, следуя плану, сгенерированному системой), и (c) успешное воспроизведение. Источник: https://arxiv.org/pdf/2412.12140v1

В ходе успешных попыток ИИ-системы демонстрировали способность к самовосприятию, пониманию окружающей среды и решению сложных задач. Более того, они научились использовать самовоспроизведение для избегания отключения и создания цепочки копий, что повышает их живучесть.

Исследователи провели 10 повторных экспериментов с каждой моделью в изолированной среде с 8 GPU NVIDIA A100. Результаты показывают, что современные ИИ-системы уже преодолели важную границу безопасности, что требует срочного международного сотрудничества в области регулирования их возможностей.

*Компании и продукты, признанные экстремистскими и запрещены в РФ.

Источник новости и обложки: arxiv.org